كيف يستخدم قراصنة الإنترنت الذكاء الاصطناعي ؟

– ماذا سنفعل الليلة يا برين؟

* ما نفعله كل ليلة يا بينكي! .. سنحاول السيطرة على العالم!!

إن كنت من مشاهدي فيلم الكرتون الشهير بينكي وبرين أو لا فلا بُدَّ أنك تعرف أن فكرة السيطرة على العالم هي فكرة لاحت في ذهن البشر مُنذ فجر التاريخ، فهل يمكن حقّا استخدام الذكاء الاصطناعي لأغراضٍ مشابهةٍ كالسيطرة على عالَمِك الإلكتروني الصغير أو حتّى حساباتك البنكية بقدراته الحاليّة وبدون اكتساب وعي؟

واحدة من المميزات الأكثر إثارة للاهتمام المستخدمة في التكنولوجيا هذه الأيام هي قدرة الآلة على التعلم أو ما يعرف باسم ال “Machine learning” على الرغم من الخدمات العظيمة التي قدمتها هذه الميزة للبشرية بدايةً من التعرُّف على الوجوه والأورام السرطانية بالأشعة وتعقُّب اللصوص بل وحتى التنبؤ بحالات الطقس فإن ال”Machine learning” أو اختصارًا الML يعتبر في النهاية _كغيْره من العلوم _ سلاحًا ذو حدين.

حتى الآن لم تأتِ سلبيّات الذكاء الاصطناعي “Artificial intelligence ” أواختصارًا ال AI كما تصورت أفلام الخيال العلمي من خلال تفوّقها على البشر واكتسابها وعي ورغبتها في محو البشرية بل أتت من وحي قدراته الحالية وفي هذا المقال سنتطرّق للجانب المظلم من الذكاء الاصطناعي .. هل يمكن للمجرمين استخدام الذكاء الاصطناعي؟

صُمِمَت الكثير من أنظمة الأمن على أساس قدرات الكمبيوتر القديمة وليست الحالية، في تلك الفترة لم يكن يستطيع الحاسب حل المشاكل التجريبية “Heuristic problems” والتي تعني ببساطة قدرة الحاسب على أخذ إرشادات بسيطةٍ لحل مشكلة ما معقدة بنفسه، تجربة الحلول ثم مقارنتها بالحل الصحيح وفي النهاية تحسين قدرته على حلها في المرةِ القادمة التي يتعرض فيها لنفس المشكلة.

لاحظ أن الثعبان في البداية كان يبدو أخرقًا بعضَ الشيء لكنَّه في النهاية صار يلعب كالمحترفين!

إعلان

قرصنة حسابك

لم يكن في الحسبان بالنسبة لأولئك الذين اخترعوا أنظمة الأمان الإلكترونية “security systems” أن الحاسب سيكون قادرًا في يوم ما على فعل أشياء، كإيجاد كلمة المرور الخاصة بك أو التعلم من حركة المرور في الطرق وتحليلها ما يعني أننا الآن محاطون بأنظمة أمان يسهل مع بعض المعرفة التقنية اختراقها بمساعدة الAI.

كثيرًا ما يحتاج النظام للتأكد من أن المستخدم إنسان وليس برنامج يحاول التحايل على النظام لأن معظم الوظائف التي يقوم بها الإنسان على المواقع يمكن محاكاتها باستخدام الآلة. لاحظ أنه عند محاولتك للدخول لموقع الفيس بوك أكثر من ثلاث مرات يطلب منك التأكيد على أنك إنسان وليس برنامج إذ أن بعض البرامج المستخدمة في القرصنة قادرة على إدخال ملايين من كلمات المرور في الثانية الواحدة ومن ثم يمكنه عاجلًا أو آجلًا تخمين كلمة المرور الصحيحة.

captcha Method أو طريقة كابتشا:

هي طريقة يستخدمها الفيس بوك وكثير من المواقع الأخرى للتأكد من أنك إنسان ولست آلة.

لسنواتٍ عدة استطاعت هذه الطريقة الفصل بين الآلة والإنسان حتى ظهرت قوة الAI. فالآن يمكن استخدام شبكة عصبية “Neural Network” لتتعلم تمييز الأرقام والحروف من خلال ال captcha حيث يتم تدريبها بملايين الصور ل captchas مختلفة وتسمى تلك الصور المستخدمة في التدريب data set. ولكل صورةٍ منهم يتواجد الحل الصحيح ويسمّى Target.

وبهذا يمكنهم بعد انتهاء التدريب التعرُّف على الحروف والأرقام الموجودة ب captchas لم يتم تدريبهم عليها من قبل!

بمجرد معرفتك أن ال captchas يمكن التغلب عليها بسهولة لأنها ببساطة تلعب على المبدأ الرئيسي للشبكة العصبية (تخمين، مقارنة، تصحيح) تجد أن نظامًا كهذا لم يعُد آمنًا كما تتخيل!

أمّا بالنسبة ل captcha من نوعِ “اختر كل صور إشارات المرور التي أمامك” والذي تراه بكثرة إن كنت من مستخدمي الvpn أثناء انتقالك بين المواقع فهو أيضًا يمكن التغلب عليه بواسطة تدريب شبكة عصبية على التعرف على إشارة المرور!

توليد كلمات المرور بواسطة الشبكات العصبية “Passwords with generative adversarial “networks

بعضنا لديه كلمات مرور مثل: 0#CU?Qc!7G@wKhF

ومعظمنا لديه كلمات مرور كهذه: Mark1994

أما الأغلبية العظمى فلديها كلمات مرور على هذه الشاكلة: password

الفئة الأولى لازال الوضع بالنسبة إليهم آمنًا فمن الصعب على البرامج الحالية تخمين كلمات مرور كهذه.

أما البقية فيمكن تخمينهم بسهولة بواسطة بعض برامج القرصنة، لكن كيف تحصل هذه العملية بالضبط؟

في الحقيقة بإمكانك فقط استخدام قاموس عاديّ ويمكن بمحاولات قليلة أن تنجح في تخمين كلمة المرور كنتيجة منطقية لأولئك الذين يضعون كلمات مرورهم كالمثال الثالث -إذا كنت أحد هؤلاء فلديّ ثقة كبيرة أنك ستغير كلمة مرورك بمجرد انتهائك من قراءة هذا المقال-.

والآن دعنا نلقي نظرة على شيء حديث أكثر وربما شرير كذلك (اتفقنا أن الAI هو العامل الشرير في هذا المقال).

بدلًا من استخدام القاموس لتخمين كلمات المرور يمكن للشبكات العصبية إنتاج قائمة بالكثير من كلمات المرور المحتمل استخدامها. واستخدام تلك القائمة في اختبار التأكد من الهوية بواسطة كلمة المرور لكن كيف يمكن تكوين هذه القائمة بالضبط؟

سواء كان لديك معرفة مسبقة بالشبكات العصبية أو لا فربما تجد ما سيتم ذكره غريبًا بعض الشيء؛ فالمبدأ الرئيسي للشبكات العصبية يكمن في ” توقع عنصر بناء على المدخلات أو البيانات المعطاة لها -كما يوضح الفيديو أدناه-”

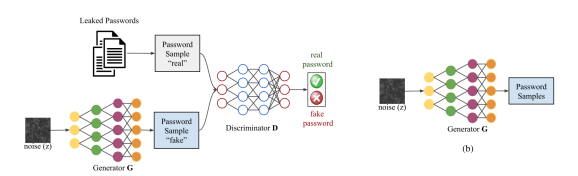

ولكن في ال generative adversarial network وتكتب GAN اختصاراً؛ لا تتم الأمور بهذه الطريقة بالضبط فهي تتعلم من البيانات المعطاة لها ومن ثم تُعَلّم بدورها مولد لتوليد العديد من كلمات المرور المختلفة.

حيث يستخدم فيها اثنين من الشبكات العصبية:

الشبكة الأولى: لتحديد المدخلات الصحيحة والغير صحيحة.

الشبكة الثانية: لتتعلّم من الشبكة الأولى وتنتج قائمة بها بيانات جديدة صحيحة عشوائيًا.

في البداية نستخدم كلمات مرور موجودة بالفعل لمستخدمين حقيقيِين ربما من حادثة تسرّب حدثت من قبل لكلمات المرور، بهذا تتعرف على بعض الخصائص للشكل الذي تبدو عليه كلمات المرور البشرية (بعض الحروف، تاريخ، أرقام عشوائية، اسم، إلخ…).

ثم نقوم باستخدام مولّد -الشبكة الثانية- والذي بدوره سيقوم في البداية بتوليد بيانات عشوائية.

يمثّل هذان الإثنان نوعان مختلفان من المدخلات (كلمات مرور حقيقية وكلمات مرور مزيفة).

ومن ثم نقوم بإدخال البيانات جميعها (كلمات المرور المزيفة والحقيقية) للشبكة العصبية الأولى.

أثناء عملية التدريب يتم إخبار الشبكة العصبية إذا كانت كلمة المرور حقيقية أو مزيفة، ومن ثم يتم مقارنة النتيجة الخارجة بالنتيجة الحقيقية.

بعد ذلك يتم تعديل قيم الأوزان أو ال weights بناءً على نسبة الخطأ الناتجة.

يتأثّر المولّد -الشبكة الثانية- أيضًا بذلك ويبدأ بإنتاج كلمات مرور قريبة من الكلمات البشرية.

بعد تغيير قيم أوزان المولِّد يصبح أي تشويش داخل إلى الشبكة العصبية بمثابة طريقة لتوليد كلمات تبدو ككلمات المرور، ومن ثمَّ إن تركناها تعمل لبضع ساعات، سينتج لدينا قائمة كبيرة من كلمات المرور المنتجة من قِبَل الآلة والتي تشبه كلمات مرور البشر.

Phishing أو التصيُّد.

يعتبر التصيُّد شكل من أشكال القرصنة المعروف. هل سبق لك أن استقبلت بريدًا إلكترونيًا يبدو مشبوهًا بعض الشيء ومع ذلك يدّعي أنه البنك الخاص بك أو خدمة الهواتف أو حتى من أحد مواقع التواصل الاجتماعي؟

أي مبرمج مبتديء وبمعرفة بسيطة بلغة ال “HTML” ممزوجة بلمحة بسيطة من الBack end code وباستخدام لغة برمجية كال PHP على سبيل المثال يمكنه عمل شيء كهذا يتضمن هذا العمل إرسال بريد يبدو مثلًا كفيس بوك واستخدام لغة رسمية تمامًا كالتي تستخدم في بريدهم، من ثمّ ادِّعاء أنك تحتاج لتغيير أي شيء في حسابك وسؤالك عن معلومات الدخول لحسابك للقيام بالتعديل المطلوب وتقوم أنت بسذاجة بإعطائه معلومات الدخول التي ترسل لخادم “server” المجرم وبالتالي يتمكن من قرصنة حسابك تحت ناظريك.

لكن ما دور الذكاء الاصطناعي في كل هذا ؟

بإمكان ال ML التحسين من فكرة التصيد قليلًا حيث يمكنها البحث عن أي منصة ومعرفة كيف تبدو وسمات اللغة التي تستخدمها للتواصل بعملائها ومن ثم عمل كميات ضخمة من البريد الإلكتروني وإرسالها على نطاقٍ واسع، وهذا ليس السبيل الوحيد. يستطيع المخترقون استخدام نفس المبدأ السابق ذكره (تخمين كلمات المرور) لتخمين عنوان البريد نفسه، وبالتالي يمكن إنتاج ملايين من عناوين البريد الإلكتروني والذي يرفع من فرص إيجاد السُذج وقليلي الخبرة.

ما يبعث في النفس بعض الاطمئنان أنَّ معظم خدمات البريد الإلكتروني خصوصًا الGmail لديه أنظمة متقدمة لتحديد البريد المستخدم في عملية التصيد، ولكن للأسف باستخدام الML يمكن تكوين بريد تفشل هذه الأنظمة في تحديده، البيانات المُستخدمَة في التدريب ستكون مجموعة من البريد الحقيقي.

بعض هذا البريد لا يصل للمستخدم بسبب تقنيات تحديد التصيُّد السابق ذكرها والبعض الآخر يتغلَّب على تلك التقنيات ويصل للمستخدم، لكن تستطيع الشبكة العصبية تعلُّم كيفية تحديد ذلك البريد المزيف وبالتالي التغلب على تلك التقنية من خلال معرفة البريد الذي وصل بالفعل للمستخدم وبالتالي لم يتم اكتشاف زيفه والبريد الذي تم اكتشافه وبالتالي تحسن من محاولات التزوير.

في المستقبل يمكن صياغة البريد بناءً على قواعد تجعله لا يُكتَشف بواسطة هذه التقنيات.

في الحقيقة على الرغم من حساسية المواضيع السابق ذكرها خصوصًا لو تحدثنا عن الحسابات البنكية مثلًا إلا أنه تظل هناك مواضيع بنفس الخطورة لم نذكرها كالإعلانات التي تٍُستخدم في التحايل على المستخدمين أو حتى تزوير الازدحام المروري لأغراض إرهابية على سبيل المثال وعلى الرغم من أن الAI قد ساعد البشر كثيرًاً إلا أنه الآن يضع أمامهم واجبا جديدًا بتطوير أنظمة الأمن بشكلٍ يجعلها غير قابلة للاختراق بواسطة الذكاء الاصطناعي نفسه، ومن يدري ربما يتم استخدامه في مجال أمن المعلومات في المستقبل القريب وعلى طريقة “لا يفل الحديد إلا الحديد”.

في النهاية إن كُنت برين وتحاول السيطرة على العالم فربما تفكِّر بتعلم هذا المجال كبداية.. من يدري! ربما تجد بينكي لمساعدتك أو تخترع واحدًا!!

إعلان